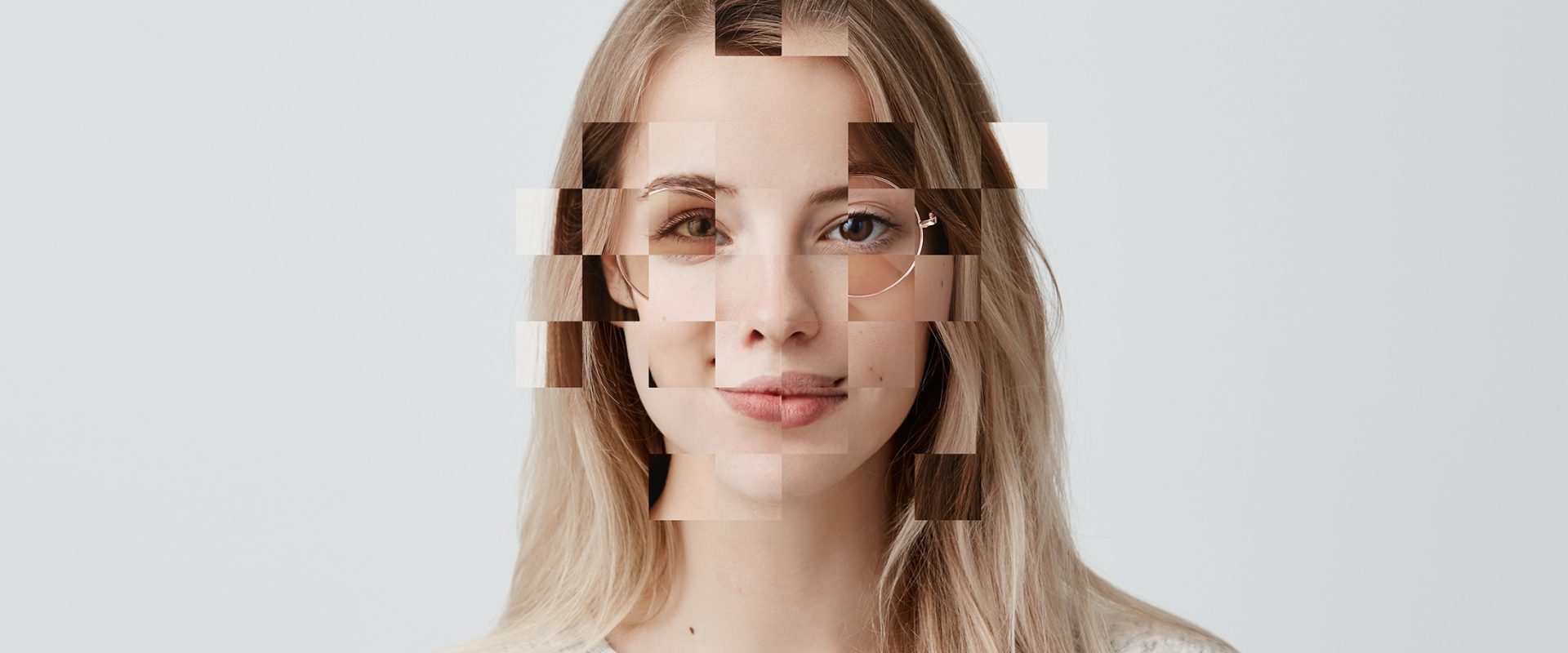

Deepfake‑urile devin rapid instrumente de fraudă digitală, iar inteligența artificială generativă permite crearea de imagini și video aproape imposibil de diferențiat de realitate. În 2025, grupările infracționale utilizează deepfake‑uri pentru escrocherii financiare, campanii de dezinformare și amenințări la adresa securității naționale. Poliția Română a publicat recent un avertisment oficial, subliniind riscurile majore ale acestor tehnologii.

Moduri de utilizare a deepfake‑urilor în fraude și înșelăciuni digitale

Escrocherii financiare și investiții false

Deepfake‑urile cu politicieni sau influenceri promovează platforme cripto inexistente, încurajând depuneri de fonduri în conturi frauduloase. Victimele sunt atrase de clipuri video care par autentice și redau o voce sincronizată impecabil.

Scam‑uri caritabile și exploatarea emoțiilor

Imagini deepfake cu copii bolnavi sau zone afectate de dezastre însoțesc linkuri de donații false. Donatorii cred că susțin o cauză reală, dar sumele ajung direct în portofelele infractorilor.

Romance scam modernizat cu AI

Profilurile false includ fețe generate de inteligență artificială și video‑call‑uri deepfake, consolidând încrederea victimei. După stabilirea unui atașament, escrocii cer bani pentru „operații medicale” sau „bilete de avion”.

Fraudă corporativă prin video‑call deepfake

Infractorii folosesc deepfake în timp real pentru a imita directorii în conferințe video, solicitând transferuri urgente. Tehnologia permite sincronizarea feței cu vocea falsă, iar sumele pot depăși milioane de euro.

Impersonare de celebrități în campanii de marketing false

Reclamele cu celebrități generate de AI promovează produse inexistente și atrag mii de consumatori. Clipurile deepfake sunt distribuite rapid pe rețelele sociale, profitând de încrederea publicului.

Impactul social și emoțional al deepfake‑urilor

- Pierderi financiare globale de zeci de miliarde de dolari.

- Traume emoționale severe, în special în romance scam‑uri.

- Erodarea încrederii în mass‑media și instituții.

- Manipulare electorală prin video‑clipuri fabricate.

- Revenge porn deepfake, vizând în special femeile.

- Riscuri de securitate națională generate de mesaje video false ale liderilor politici.

Cum se identifică și se previne un deepfake

- Clipuri cu sincronizare imperfectă buze‑voce.

- Umbră și iluminare neconcordante cu mediul.

- Reflexii anormale în ochi sau dinți.

- Deformări la nivelul mâinilor, urechilor sau părului.

- Artefecte la marginea feței și pupile asimetrice.

- Căutarea inversă a imaginilor pentru verificare.

Măsuri de protecție:

- Nu accesa linkuri din reclame sau mesaje nesolicitate.

- Verifică întotdeauna conturile oficiale ale persoanelor care promovează investiții sau donații.

- Activează autentificarea în doi pași, preferabil prin aplicație.

- Utilizează extensii de browser care semnalează conținut deepfake.

- Raportează imediat conținutul suspect autorităților.

- Poliția nu solicită niciodată transferuri prin video‑call și nu recomandă investiții în mod direct.

Conștientizarea riscurilor asociate deepfake‑urilor și monitorizarea constantă a evoluțiilor tehnologiei reprezintă pași esențiali pentru reducerea impactului fraudelor digitale.

Fii primul care comentează